- +1

搞懂這5個(gè)模塊,你才真的懂AI Agent

“構(gòu)建AI Agent的底層技術(shù)全指南,建議收藏!

最近,一大波“AI Agent”項(xiàng)目在朋友圈刷屏,仿佛誰不搞個(gè)Agent,就像Web3時(shí)期誰不發(fā)幣,GenAI時(shí)期誰不用GPT——都顯得“落后于時(shí)代”。

從Auto-GPT到Devin,再到MCP、 A2A協(xié)作、多角色Agent編排,AI Agent已然成為當(dāng)前最熾熱的技術(shù)風(fēng)口之一。

但熱度之下,也有混亂正在蔓延:

很多初創(chuàng)項(xiàng)目把一個(gè)加了“工具調(diào)用”的prompt,當(dāng)作Agent系統(tǒng);

不少企業(yè)部署了所謂Agent,結(jié)果發(fā)現(xiàn)只是“自動(dòng)填表機(jī)器人+LLM問答助手”的拼裝體;

一些開發(fā)者以為接個(gè)大模型、套個(gè)API,就構(gòu)建了一個(gè)智能體,卻在實(shí)際運(yùn)行中發(fā)現(xiàn)系統(tǒng)崩潰、狀態(tài)丟失、工具失敗后“無腦重試”……

AI Agent并不是prompt拼接游戲,也不是LLM的UI封裝。它是一種系統(tǒng)工程。

真正的Agent,是具備狀態(tài)感知、任務(wù)分解、上下文記憶、工具交互、行為反饋與自主規(guī)劃能力的復(fù)雜智能系統(tǒng)。

如果說大語言模型是“大腦”,那么一個(gè)真正的Agent,還需要“身體”、“感官”、“行動(dòng)系統(tǒng)”以及“神經(jīng)網(wǎng)絡(luò)”。

本篇文章,我們將深入拆解:

·構(gòu)建一個(gè)AI Agent到底需要哪些核心技術(shù)能力?

·LLM、Memory、Planner、Tool-use、Reflection之間如何協(xié)同構(gòu)成一個(gè)閉環(huán)系統(tǒng)?

·MCP、ReAct、A2A等主流架構(gòu)的異同與適用場景

·當(dāng)前Agent系統(tǒng)中的四大關(guān)鍵挑戰(zhàn)與工程難題

理解Agent的底層邏輯,不只是“會(huì)用”,更是“會(huì)設(shè)計(jì)、會(huì)評(píng)估、會(huì)擴(kuò)展”的關(guān)鍵。尤其對產(chǎn)品人、AI 工程師、決策者來說,只有真正看懂Agent的技術(shù)圖譜,才談得上布局未來。

AI Agent架構(gòu)全景圖:

不是“一個(gè)大模型”,而是一整套系統(tǒng)

在很多人的認(rèn)知中,構(gòu)建一個(gè)AI Agent似乎很簡單:

“接入一個(gè)強(qiáng)大的大語言模型,再加點(diǎn)插件或API調(diào)用,就可以自動(dòng)完成復(fù)雜任務(wù)。”

但事實(shí)是:語言模型只是Agent的“大腦”,真正讓它能完成任務(wù)、感知環(huán)境、保持狀態(tài)、執(zhí)行動(dòng)作的,是整個(gè)配套系統(tǒng)。

一個(gè)成熟、可運(yùn)行、可迭代的AI Agent,至少需要以下五大核心模塊:

1. LLM(語言模型):Agent的認(rèn)知中樞

語言模型提供了Agent的“理解力”和“語言生成能力”,也是Agent能進(jìn)行任務(wù)規(guī)劃、意圖識(shí)別、自然語言交互的基礎(chǔ)。

·功能作用:解析用戶意圖、生成子任務(wù)、撰寫輸出內(nèi)容

·典型模型:DeepSeek、通義千問、文心一言、豆包、GPT-5、Claude等

·局限提醒:LLM不具備長期記憶、狀態(tài)管理和執(zhí)行能力,它只是Agent的“智囊”,不是“執(zhí)行者”

2. Memory(記憶系統(tǒng)):上下文感知的延續(xù)器

Agent在執(zhí)行任務(wù)時(shí),不能是“一問一答”的短期記憶體,它需要理解歷史、跟蹤狀態(tài)、動(dòng)態(tài)適應(yīng)用戶目標(biāo)。

·功能作用:保存對話上下文、記錄任務(wù)進(jìn)度、調(diào)用歷史經(jīng)驗(yàn)

·主流實(shí)現(xiàn):短期記憶(Session Buffer)、長期記憶(基于向量庫,如 Chroma、Weaviate)、工作記憶(當(dāng)前步驟+狀態(tài)+Action歷史)

·現(xiàn)實(shí)挑戰(zhàn):上下文提取與召回易錯(cuò)亂,信息冗余、沖突、更新策略不統(tǒng)一。

3. Planning(任務(wù)規(guī)劃器):從目標(biāo)到執(zhí)行路徑

Agent面對一個(gè)復(fù)雜目標(biāo),必須將其拆解成可執(zhí)行的子任務(wù)序列,并動(dòng)態(tài)更新執(zhí)行計(jì)劃。

·功能作用:任務(wù)分解、流程編排、子目標(biāo)生成

·常見機(jī)制:基于規(guī)則(Flowchart、State Machine)、基于模型(ReAct、Chain-of-Thought)、混合型調(diào)度器(如 LangGraph)

·重點(diǎn)難點(diǎn):如何平衡計(jì)劃的泛化能力與可控性

4. Tool-use(工具調(diào)用引擎):Agent的“手腳”

沒有工具調(diào)用能力的Agent,只能“說”不能“做”。Tool-use機(jī)制讓Agent能與外部世界交互、執(zhí)行動(dòng)作。

·功能作用:執(zhí)行API、檢索信息、讀取文件、發(fā)送請求等

·關(guān)鍵設(shè)計(jì):Action Schema(調(diào)用格式定義)、Tool Router(工具選擇器)、Error Handling(錯(cuò)誤處理、重試、回滾)

·常見實(shí)現(xiàn):LangChain Tools、OpenAI Function calling、HuggingGPT Tool Hub

5. Reflection(自我反思與策略調(diào)整):Agent的“元認(rèn)知能力”

在任務(wù)執(zhí)行失敗或結(jié)果不佳時(shí),一個(gè)強(qiáng)健的Agent應(yīng)該能審視自身行為,主動(dòng)修正策略。

·功能作用:評(píng)估執(zhí)行效果、記錄失敗經(jīng)驗(yàn)、調(diào)整執(zhí)行路徑

·方法代表:Reflexion、Tree-of-Thought(ToT)、Critic Agent+Actor Agent 架構(gòu)、CoT+ReAct組合策略

·挑戰(zhàn)提醒:反思機(jī)制往往依賴LLM自我監(jiān)督,存在hallucination風(fēng)險(xiǎn)

每一層都不可或缺,真正的Agent系統(tǒng)不是“疊prompt”,而是一個(gè)狀態(tài)驅(qū)動(dòng)+意圖分解+工具調(diào)用+自我學(xué)習(xí)的閉環(huán)系統(tǒng)。

Agent≠模型增強(qiáng)器,而是多模塊協(xié)同的智能執(zhí)行體。理解架構(gòu),就是理解Agent能力的邊界。

要構(gòu)建一個(gè)可運(yùn)行、可擴(kuò)展的AI Agent,開發(fā)者必須掌握的不只是Prompt編寫,更要理解其背后每個(gè)模塊的功能、技術(shù)實(shí)現(xiàn)方式、主流方案與當(dāng)前的成熟度。

下面,我們從五個(gè)關(guān)鍵模塊出發(fā),逐一拆解其技術(shù)原理與行業(yè)現(xiàn)狀。

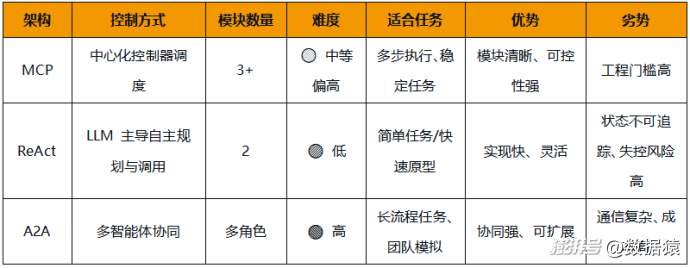

技術(shù)對比總覽表:

三大關(guān)鍵架構(gòu)模型對比:MCP/ReAct/A2A

雖然AI Agent的實(shí)現(xiàn)可以多種多樣,但當(dāng)前主流的Agent系統(tǒng),大致可以歸入以下三種架構(gòu)模型:

1.MCP架構(gòu)(Memory–Controller–Planner)

2.ReAct框架(Reasoning + Acting)

3.A2A架構(gòu)(Agent-to-Agent協(xié)作)

它們在模塊拆解、任務(wù)控制方式、執(zhí)行流程與適用場景上,都體現(xiàn)了不同的技術(shù)思路與設(shè)計(jì)哲學(xué)。

1. MCP架構(gòu):工程化Agent的系統(tǒng)思維代表

全稱:Memory+Controller+Planner

架構(gòu)特點(diǎn):Memory負(fù)責(zé)保存上下文與狀態(tài)信息;Planner負(fù)責(zé)對用戶目標(biāo)進(jìn)行子任務(wù)規(guī)劃;Controller作為調(diào)度核心,協(xié)調(diào)各模塊及工具調(diào)用;可擴(kuò)展為多Agent協(xié)作(如UserAgent+TaskAgent+CriticAgent)。

優(yōu)勢:結(jié)構(gòu)清晰,職責(zé)明確,便于模塊替換與系統(tǒng)維護(hù);支持多 Agent 組件之間的異步通信;非常適合 B 端企業(yè)對穩(wěn)定性、可控性有較高要求的場景。

局限:開發(fā)門檻高,系統(tǒng)復(fù)雜度較大;需要大量設(shè)計(jì)“控制邏輯”和狀態(tài)傳遞機(jī)制。

適合人群: 有工程能力的團(tuán)隊(duì)、希望構(gòu)建穩(wěn)定長流程系統(tǒng)的企業(yè)用戶。

2. ReAct框架:廣泛使用的“輕量級(jí)智能體原型”

全稱:Reasoning+Acting

架構(gòu)特點(diǎn):LLM在推理過程中決定要不要調(diào)用工具;工具調(diào)用后將結(jié)果重新反饋給LLM;交替進(jìn)行“思考(Think)→行動(dòng)(Act)”的閉環(huán)對話流。

示例流程:

User: 查詢北京明天的天氣→LLM思考:我需要調(diào)用weather API→Act: 執(zhí)行API→Observe: 天氣結(jié)果→再次Reason+Act...

優(yōu)勢:構(gòu)建簡單,易于理解和實(shí)驗(yàn);高度靈活,幾乎所有LLM都能上手。

局限:流程不透明,可控性差;任務(wù)狀態(tài)管理混亂,適合短流程任務(wù)或原型驗(yàn)證。

適合人群: 快速驗(yàn)證Agent概念的開發(fā)者、獨(dú)立開發(fā)者、AI Hackathon團(tuán)隊(duì)。

3. A2A架構(gòu):從“單智能體”到“多智能協(xié)作”的演化路徑

全稱: Agent-to-Agent

架構(gòu)特點(diǎn):多個(gè)具備不同職責(zé)的Agent聯(lián)合組成一個(gè)“任務(wù)團(tuán)隊(duì)”;每個(gè)Agent可以獨(dú)立決策,也可以協(xié)商任務(wù);類似現(xiàn)實(shí)世界的“協(xié)作組織模型”。

舉例角色:

·PM Agent:負(fù)責(zé)拆解任務(wù)

·Dev Agent:負(fù)責(zé)編寫代碼

·QA Agent:負(fù)責(zé)驗(yàn)證和測試

·Critic Agent:進(jìn)行最終審查與評(píng)估

優(yōu)勢:高度模塊化,適合復(fù)雜任務(wù)協(xié)作;更接近現(xiàn)實(shí)組織結(jié)構(gòu),有利于人機(jī)混合工作流整合。

局限:調(diào)度難度極高,Agent間通信協(xié)議尚未統(tǒng)一;容易出現(xiàn)循環(huán)協(xié)商、狀態(tài)漂移、響應(yīng)延遲等問題;成本高,Agent數(shù)量多意味著更多LLM調(diào)用開銷。

適合人群: 對多角色智能體協(xié)同有實(shí)際需求的場景(如代碼生成、項(xiàng)目管理、仿真)。

對比總結(jié):

不同架構(gòu)沒有絕對優(yōu)劣,關(guān)鍵在于你的目標(biāo)是:輕量實(shí)驗(yàn)?工程部署?還是智能協(xié)作?對大多數(shù)項(xiàng)目而言,從ReAct起步、向MCP過渡、最終引入A2A模型,是當(dāng)前最具現(xiàn)實(shí)性的演進(jìn)路徑。

AI Agent架構(gòu)設(shè)計(jì)的四個(gè)難點(diǎn)

(也是創(chuàng)新機(jī)會(huì))

很多人以為AI Agent的難點(diǎn)只是“模型夠不夠強(qiáng)”。

但現(xiàn)實(shí)是,真正拉開Agent能力差距的,不是大腦,而是系統(tǒng)工程。

哪怕你用了最強(qiáng)的GPT-4o或Claude 3,如果下面這幾個(gè)問題解決不了,Agent依然會(huì)“跑偏、跑斷、跑廢”。

以下是當(dāng)前Agent架構(gòu)中最核心的四個(gè)工程難題:

1. 狀態(tài)管理困難:Agent不知道自己“做到哪一步了”

問題現(xiàn)象:Agent執(zhí)行多步任務(wù)時(shí),經(jīng)常“斷片”或重復(fù)同一操作;對“上一步結(jié)果”的引用依賴LLM記憶,極易錯(cuò)誤;缺乏統(tǒng)一狀態(tài)描述方式,流程一旦中斷就無法恢復(fù)。

本質(zhì)挑戰(zhàn):多輪任務(wù)的“中間狀態(tài)”在系統(tǒng)中沒有結(jié)構(gòu)化表達(dá);大模型沒有顯式的任務(wù)感知機(jī)制,只靠上下文拼接。

潛在解決方向:引入狀態(tài)機(jī)(State Machine)或有向圖(DAG)進(jìn)行流程建模;結(jié)合LangGraph等框架,實(shí)現(xiàn)任務(wù)節(jié)點(diǎn)與狀態(tài)顯式映射。

2.工具調(diào)用的魯棒性差:一旦失敗,Agent無法“補(bǔ)救”

問題現(xiàn)象:API出錯(cuò)后Agent不知所措,要么死循環(huán)重試,要么放棄任務(wù);多工具組合調(diào)用后缺少統(tǒng)一反饋機(jī)制;工具響應(yīng)格式微變,就可能導(dǎo)致整個(gè)鏈路崩潰。

本質(zhì)挑戰(zhàn):當(dāng)前Agent缺乏工具調(diào)用的異常感知機(jī)制和容錯(cuò)策略;沒有標(biāo)準(zhǔn)化的Action Schema和異常捕捉框架。

潛在解決方向:類似“Tool Result Handler”的模塊獨(dú)立封裝;構(gòu)建Tool Wrapper,為每個(gè)工具提供error+fallback策略;Agent具備“判斷是否繼續(xù)”的元認(rèn)知能力(如驗(yàn)證函數(shù)、CriticAgent)。

3.計(jì)劃模塊依賴黑箱模型:可控性與調(diào)試性差

問題現(xiàn)象:Agent的任務(wù)分解高度依賴語言模型輸出;很難驗(yàn)證拆分是否合理、是否高效;出現(xiàn)計(jì)劃錯(cuò)誤時(shí),開發(fā)者無法追蹤“哪里出問題”。

本質(zhì)挑戰(zhàn):缺乏一種中間表示語言(Intermediate Planning DSL),用于計(jì)劃與執(zhí)行解耦;Planner與Executor強(qiáng)耦合,導(dǎo)致系統(tǒng)不可測試。

潛在解決方向:模型生成JSON Plan→Plan解釋器執(zhí)行(LangGraph、MetaGPT的方式);引入可視化任務(wù)流(如Flowchart DSL、Node Execution Tree)提高可解釋性。

4.可控性和透明性差:Agent做了什么,你不知道

問題現(xiàn)象:Agent調(diào)用了哪些工具、使用了哪些數(shù)據(jù)、基于什么理由采取某種行為——全在“黑箱”里;企業(yè)無法審核Agent行為路徑,存在合規(guī)和安全隱患;Agent的輸出結(jié)果難以復(fù)盤、難以定位問題。

本質(zhì)挑戰(zhàn):當(dāng)前Agent缺乏“行為日志+決策說明”的雙重記錄機(jī)制;決策鏈路完全依賴LLM內(nèi)部生成,開發(fā)者難以干預(yù)。

潛在解決方向:構(gòu)建Agent Execution Log:記錄每次Act、Tool-call、Output;增加“Why did I do this?”機(jī)制:由LLM輸出簡要決策理由;面向企業(yè)推出可審計(jì)型Agent系統(tǒng)(Audit-friendly Agent)。

AI Agent架構(gòu)難點(diǎn)vs解決方向

真正構(gòu)建Agent,不是調(diào)大參數(shù)或拼API,而是面對這些“系統(tǒng)級(jí)痛點(diǎn)”,用工程設(shè)計(jì)一一攻克。

未來屬于“懂架構(gòu)”的Agent工匠

AI Agent的熱潮背后,其實(shí)并不是一場“模型競賽”,而是一場架構(gòu)能力的比拼。

從Auto-GPT到Devin,我們看到的不是Prompt工程的勝利,而是系統(tǒng)性設(shè)計(jì)思維的回歸:

·誰能穩(wěn)定管理任務(wù)狀態(tài);

·誰能優(yōu)雅調(diào)度工具與模型;

·誰能實(shí)現(xiàn)結(jié)構(gòu)清晰、易維護(hù)、可審計(jì)的執(zhí)行閉環(huán);

·誰就能在這場智能代理的技術(shù)革命中站穩(wěn)腳跟。

語言模型會(huì)越來越強(qiáng),但不會(huì)幫你搭系統(tǒng)。

Agent架構(gòu),是下一代AI應(yīng)用的核心戰(zhàn)場。能否理解“Memory–Planning–Tool-use–Reflection”的協(xié)同邏輯,能否構(gòu)建“透明、可控、可拓展”的任務(wù)系統(tǒng),決定了一個(gè)團(tuán)隊(duì)是否真正具備打造Agent應(yīng)用的核心競爭力。

給不同角色的建議:

·開發(fā)者:你的核心競爭力將不再是prompt寫得好,而是有沒有能力抽象、建模、調(diào)度與約束一個(gè)復(fù)雜系統(tǒng)。

·產(chǎn)品經(jīng)理:不要幻想Agent是“萬能解決方案”,你的任務(wù)是定義Agent和人的角色邊界,設(shè)計(jì)好交互模式。

·技術(shù)決策者:別只看demo,要看系統(tǒng)架構(gòu)的穩(wěn)定性、擴(kuò)展性和落地的復(fù)雜度。真正能部署的Agent,不一定是最“聰明”的,而是最“穩(wěn)妥”的。

AI Agent并不是一個(gè)產(chǎn)品,而是一種新軟件形態(tài)。它不是更強(qiáng)的機(jī)器人,而是更復(fù)雜的“數(shù)字個(gè)體”。它的難點(diǎn),不在于想象力,而在于工程能力。所以未來屬于那些既懂AI,又懂系統(tǒng)架構(gòu)的“Agent工匠”。

本文為澎湃號(hào)作者或機(jī)構(gòu)在澎湃新聞上傳并發(fā)布,僅代表該作者或機(jī)構(gòu)觀點(diǎn),不代表澎湃新聞的觀點(diǎn)或立場,澎湃新聞僅提供信息發(fā)布平臺(tái)。申請澎湃號(hào)請用電腦訪問http://renzheng.thepaper.cn。

- 報(bào)料熱線: 021-962866

- 報(bào)料郵箱: news@thepaper.cn

滬公網(wǎng)安備31010602000299號(hào)

互聯(lián)網(wǎng)新聞信息服務(wù)許可證:31120170006

增值電信業(yè)務(wù)經(jīng)營許可證:滬B2-2017116

? 2014-2025 上海東方報(bào)業(yè)有限公司